Аналитические возможности YDB

Аналитические возможности YDB

Колоночное хранение, параллельная обработка и стоимостной оптимизатор для тяжёлых аналитических запросов.

Основные преимущества

Распределённая отказоустойчивая SQL СУБД, которая позволяет разработчикам строить масштабируемые и высокодоступные сервисы. Обеспечивает строгую консистентность, высокую скорость обработки данных, отлично подходит для высоконагруженных аналитических задач.

Раздельный compute и storage

Хранение и вычисления масштабируются независимо, что позволяет обрабатывать задачи любой сложности и любые объёмы данных

Высокая скорость обработки

MPP (Massively Parallel Processing) — параллельное выполнение запросов с линейным ростом производительности при масштабировании

Одна база. Все виды аналитических запросов

Витрины данных, сложные JOIN’ы, тяжёлые ELT‑запросы — всё это доступно в одной базе данных

Аналитика больших данных

В основе YDB — колоночные таблицы и MPP‑архитектура: тяжёлые запросы выполняются предсказуемо и масштабируются с ростом кластера.

Колоночные таблицы

Оптимизация под работу с большими массивами данных. Эффективное сжатие и передача данных.

Параллельное выполнение

Сканирование и соединения выполняются на всех узлах, производительность растёт линейно.

Витрины и BI

Быстрый отклик дашбордов на колоночных таблицах, высокие результаты в тестах ClickBench для сценариев витрин данных.

Спроектировано для тяжёлых запросов

Автоматическая ребалансировка партиций, отсутствие единой точки отказа, постоянная оптимизация хранения и предсказуемые планы выполнения.

Разделение compute и storage

Масштабирование CPU и слоя хранения производится независимо для минимизации TCO.

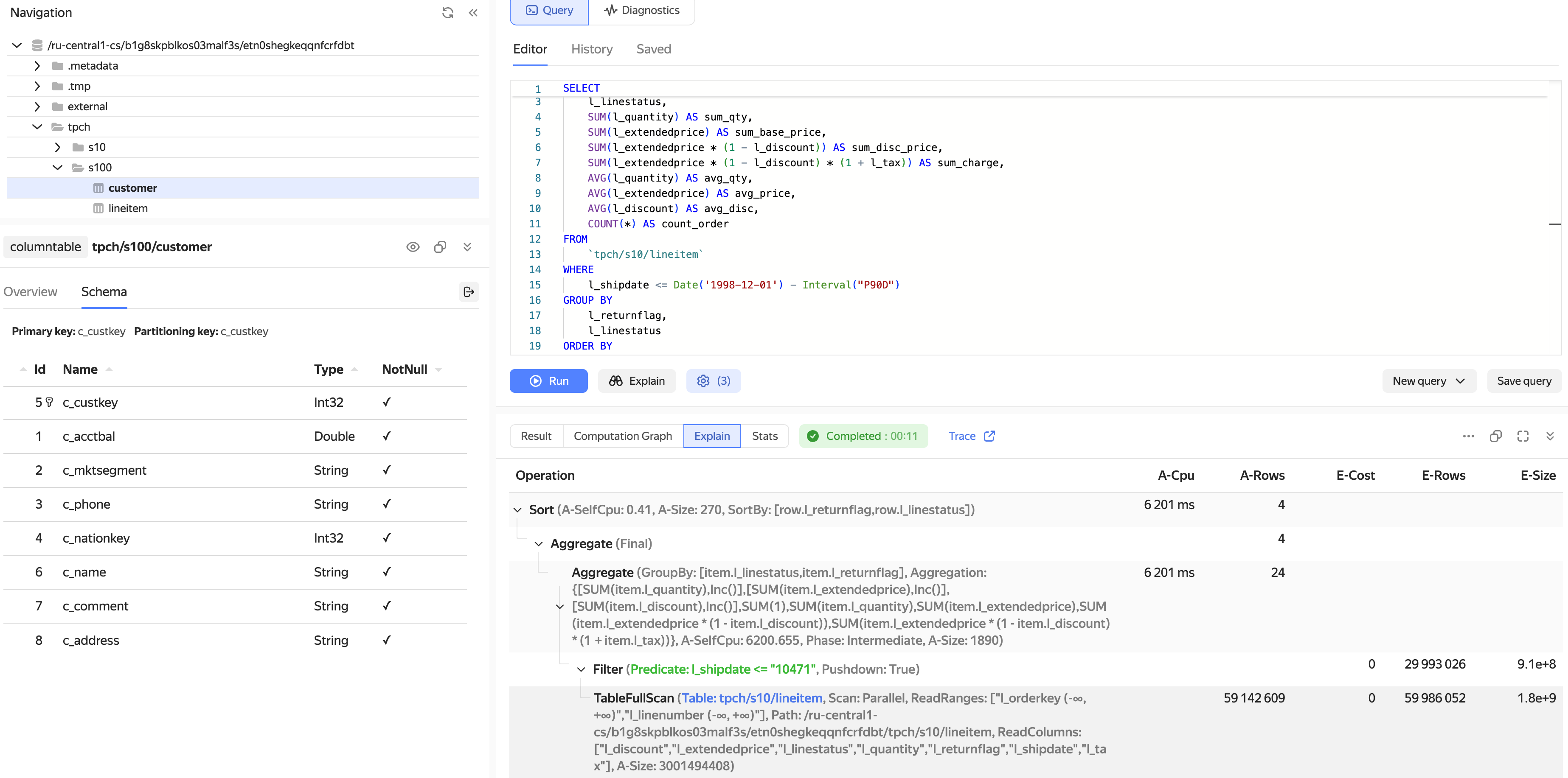

Стоимостной оптимизатор

Современный Cost‑Based Optimizer подбирает оптимальные планы для запросов с десятками и сотнями таблиц.

Тиринг данных в S3 в разработке

Автоматическое перемещение «холодных» данных в S3‑совместимые хранилища для снижения стоимости хранения, с сохранением полного доступа для запросов.

Центр обработки ваших данных

Встроенные топики с поддержкой Kafka® API, чтение из большого числа внешних источников, поддержка работы с Data Lake.

Потоковый ввод данных

Получение потоков данных в реальном времени из любых источников с помощью Kafka API

Пакетный ввод данных

Загружайте данные с помощью драйвера Apache Spark™, JDBC, FluentBit/LogStash, SDK для различных языков программирования

Встроенный трансфер данных

Обновляйте витрины из OLTP‑таблиц и внешних систем с помощью встроенного механизма TRANSFER

Большинство задач решается с помощью SQL

-- Создание колоночной таблицы

CREATE TABLE transactions_columnar (

transaction_id Uint64,

transaction_date Date,

revenue Double,

PRIMARY KEY (transaction_date, transaction_id)

) WITH (

STORE=COLUMN

);

Привычные инструменты дата‑инженера

Поддержка трансформаций данных с помощью плагина к DBT

Адаптер DBT для YDB позволяет описывать модели, инкрементальные обновления и тесты в знакомом синтаксисе и выполнять их напрямую в YDB.

Оркестрация с помощью Airflow®

Интеграция с Airflow позволяет запускать DAG для загрузки и трансформаций в YDB, управляя зависимостями, ретраями и проверками на каждом шаге.

Обработка больших данных с помощью Apache Spark

Коннектор для Spark позволяет выполнять ETL-процессы и аналитику, достигая высокой скорости за счёт параллельного чтения данных напрямую из каждого узла YDB.

Аналитика и оптимизация запросов

BI-интеграции

Стройте интерактивные дашборды и отчеты в привычных BI‑инструментах. YDB нативно интегрируется с Apache Superset™, Yandex DataLens, Polymatica и другими системами.

Анализ производительности запросов

Анализируйте и оптимизируйте каждый запрос с помощью детального плана выполнения (EXPLAIN / ANALYZE) и фиксируйте его с помощью Query Hints.

Apache®, Apache Kafka®, Apache Spark™, Apache Airflow® и Apache Superset™ являются зарегистрированными товарными знаками или товарными знаками Apache Software Foundation в США и/или других странах.

ClickHouse является зарегистрированным товарным знаком ClickHouse, Inc.